- 13-12-2024

- AI

Uma nova estrutura de geração de imagens permite que os investigadores controlem o conteúdo usando imagens de referência, melhorando o alinhamento e gerando imagens com 85% de precisão.

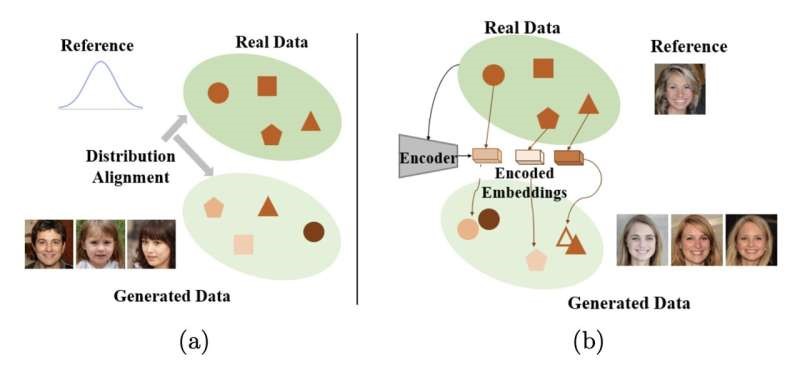

O novo framework de geração de imagens desenvolvido pelos investigadores da Seoul National University of Science and Technology resolve o desafio de controlar o conteúdo nas imagens geradas, uma limitação comum dos modelos gerativos tradicionais, como os GANs. Enquanto os GANs frequentemente produzem imagens sintéticas aleatórias, o novo framework permite que os usuários especifiquem o conteúdo desejado, utilizando uma imagem de referência. Esse processo de preservação de conteúdo é alcançado por meio de técnicas avançadas de codificação, que envolvem dois componentes principais: o módulo de codificação de frequência e o módulo de fusão de conteúdo.

O módulo de codificação de frequência captura características e estruturas-chave da imagem de referência, focando em componentes de frequência específicos, enquanto o módulo de fusão de conteúdo cria um vetor orientador que encapsula as características de conteúdo desejadas. Esses vetores orientadores de conteúdo são então combinados com vetores de ruído projetados durante o processo de geração da imagem, garantindo que a saída mantenha o conteúdo da imagem de referência, mas introduza variações estilísticas.

Nos testes, o framework superou os modelos tradicionais baseados em GAN, gerando imagens que se alinharam melhor com a imagem de referência, retendo cerca de 85% de seus atributos principais. Este framework inovador mostra promessas não apenas para gerar conjuntos de dados altamente personalizados para treinar modelos de visão computacional, mas também para áreas criativas, como o design, onde o controle preciso sobre o conteúdo gerado é crucial. A capacidade de criar imagens que atendem a expectativas específicas abre novas possibilidades para a criação e design assistidos por IA, oferecendo uma melhoria significativa em relação aos modelos gerativos atuais.