- 10-04-2026

- Artificial Intelligence

Um novo método de pesquisa permite prever com precisão como modelos de linguagem de grande escala (LLMs) irão se comportar em tarefas que nunca encontraram antes.

Um estudo recente apresenta uma estrutura inovadora para avaliar modelos de linguagem de grande escala (LLMs), mudando o foco de benchmarks retrospectivos para a previsão de desempenho futuro. Tradicionalmente, sistemas de IA são testados em conjuntos de dados predefinidos, mas essa abordagem muitas vezes não consegue capturar como os modelos se comportam em cenários novos ou do mundo real.

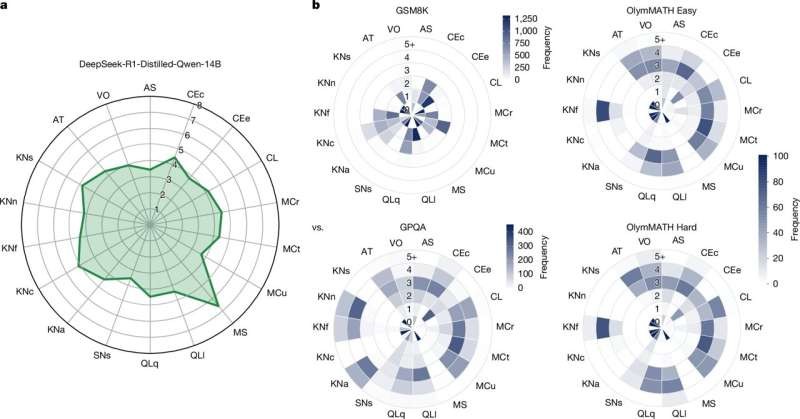

O método proposto, conhecido como ADeLe, aborda essa limitação ao avaliar sistemas de IA em 18 dimensões cognitivas distintas, incluindo raciocínio, memória e complexidade de tarefas. Essa análise multidimensional cria um perfil abrangente de capacidades para cada modelo, permitindo prever seu desempenho em tarefas totalmente novas com cerca de 90% de precisão.

Uma das principais descobertas dessa pesquisa é que muitos benchmarks atuais não medem efetivamente as capacidades que pretendem avaliar. Em vez disso, podem acabar avaliando habilidades não relacionadas, levando a conclusões equivocadas sobre a real inteligência do modelo. Em contraste, essa nova abordagem oferece tanto poder preditivo quanto explicativo, ajudando a identificar pontos fortes e fracos antes da implementação.

Esse avanço tem implicações significativas para indústrias que dependem de IA, pois reduz incertezas e riscos. As organizações podem tomar decisões mais informadas ao selecionar ou implementar modelos, garantindo melhor alinhamento com casos de uso específicos.

No geral, esse trabalho representa um passo importante para o desenvolvimento de sistemas de IA mais confiáveis, interpretáveis e robustos. Ele reforça a ideia de que entender o comportamento da IA antecipadamente é tão importante quanto melhorar seu desempenho.