- 27-04-2022

- MACHINE LEARNING

Uma equipa de investigadores dos EUA desenvolveu e demonstrou duas novas técnicas para melhor compreender os problemas inversos.

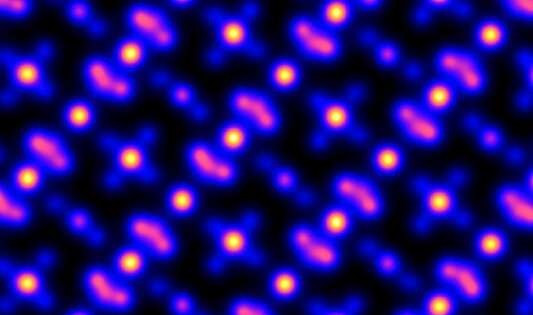

Os supercomputadores ajudam os investigadores a estudar as causas e os efeitos - geralmente nessa ordem - de fenómenos complexos. No entanto, os cientistas ocasionalmente precisam de deduzir as origens de fenómenos científicos com base em resultados observáveis. Estes denominados problemas inversos são notoriamente difíceis de resolver, especialmente quando a quantidade de dados a serem analisados ultrapassa as ferramentas tradicionais de aprendizagem automática.

Para reduzir a comunicação de coordenador-trabalhador, que muitas vezes envolve repetir os mesmos pedidos várias vezes, a equipa introduziu uma cache de resposta que armazena os metadados de cada pedido. A primeira das novas estratégias foi esta abordagem de caching, que permite reconhecer e calcular automaticamente pedidos familiares.

A segunda nova técnica envolve agrupar as operações matemáticas de vários modelos DNN, que simplifica tarefas e melhora a eficiência de escala - o número total de imagens processadas por etapa de treino - tirando partido das semelhanças nos cálculos de cada modelo. Este processo também leva a melhorias significativas no uso da energia.

Ao agrupar estrategicamente estes modelos, a equipa pretende eventualmente formar um único modelo em várias GPUs e obter a mesma eficiência obtida ao treinar um modelo por GPU.