- 20-03-2026

- Artificial Intelligence

Investigadores desenvolveram um novo método que permite aos modelos de inteligência artificial explicar as suas previsões através de conceitos compreensíveis para humanos.

Os modelos de inteligência artificial, especialmente os utilizados em visão computacional, são frequentemente muito precisos, mas difíceis de interpretar. Em aplicações críticas como saúde, condução autónoma e monitorização de segurança, compreender o raciocínio por trás de uma decisão da IA é essencial para garantir confiança e utilização segura.

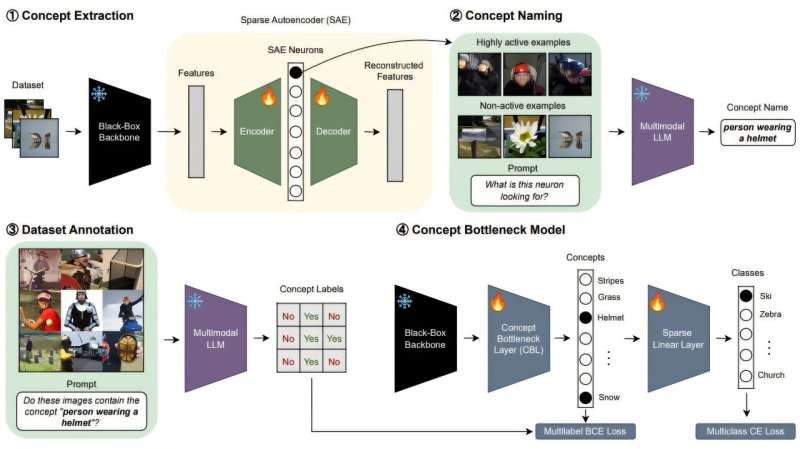

Uma das abordagens utilizadas para melhorar a transparência é conhecida como concept bottleneck modeling, em que os modelos fazem previsões com base em conceitos intermédios compreensíveis para humanos, como padrões visuais ou características específicas nas imagens.

No entanto, estes conceitos são geralmente definidos previamente por especialistas humanos. Quando os conceitos escolhidos não representam totalmente a informação utilizada pelo modelo, isso pode limitar o desempenho e a capacidade de explicação do sistema.

Para resolver esta limitação, os investigadores desenvolveram uma nova técnica que permite extrair automaticamente os conceitos que o modelo de IA já aprendeu durante o treino. O método analisa a estrutura interna do modelo e traduz as suas representações em explicações compreensíveis para humanos.

Esta abordagem permite tornar os sistemas de visão computacional mais interpretáveis sem necessidade de os treinar novamente. Ao revelar como as previsões são geradas, ajuda investigadores e engenheiros a compreender melhor o comportamento da IA.

À medida que a inteligência artificial é cada vez mais utilizada em ambientes críticos, melhorar a explicabilidade será essencial para garantir transparência, responsabilidade e confiança nas tecnologias de IA.